Информация нуждается в измерении. На практике количество информации измеряется с точки зрения синтаксической адекватности. Исторически сложились два подхода к измерению информации: вероятностный и объемный. В 1940-х гг. К. Шеннон предложил вероятностный подход, а работы по созданию ЭВМ способствовали развитию объемного подхода.

Рассмотрим вероятностный подход к измерению количества информации.

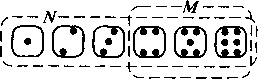

Пусть система а может принимать одно из N состояний в каждый момент времени, причем каждое из состояний равновероятно. Например, в качестве системы могут выступать опыты с подбрасыванием монеты (N = 2) или бросанием игральной кости (N= 6).Количество информации системы а вычисляется по формуле, предложенной Р. Хартли:H = H(a) = log2N= lnN/ln2. При N =2 количество информации минимально и равно Н = 1. Поэтому в качестве единицы информации принимается количество информации, связанное с двумя равновероятными состояниями системы, например: «орел» — «решка», «ложь» — «истина». Такая единица количества информации называется бит. Введем понятие вероятности. Вероятность события А — это отношение числа случаев М, благоприятствующих событию А, к общему количеству случаев N:

Пример 1. Найти вероятность выпадения числа 6 при бросании кости.Решение. Всего граней у кости N = 6. Число 6 присутствует только на одной грани.

|

Следовательно, вероятность выпадения числа 6 при бросании кости: Р=M/N/

Пример 2. Найти вероятность выпадения числа, большего 3, при бросании кости.

Решение. Всего граней у кости N = 6. Чисел, больших 3, на гранях кости М= 3.

|

Следовательно, вероятность выпадения числа, большего 3, при бросании кости: P=M/N=3/6=1/2. Если N состояний системы не равновероятны, т.е. система находится в i-м состоянии с вероятностью Pi и при этом все состояния системы образуют полную группу событий, т.е. сумма вероятностей равна:  , то используются следующие формулы, предложенные Шенноном. Для определения количества информации:a)в одном (i-м) состоянии системы H=Log2 (1/

, то используются следующие формулы, предложенные Шенноном. Для определения количества информации:a)в одном (i-м) состоянии системы H=Log2 (1/  ); b)среднего количества информации во всех состояниях системы:

); b)среднего количества информации во всех состояниях системы:

H=-

H=-

Из приведенных выражений следует, что количество информации максимально, если состояния системы равновероятны.

Объемный подход

Объем данных V в сообщении измеряется количеством символов (разрядов) в этом сообщении. В информатике в основном используется двоичная система счисления, т.е. все числа представляются двумя цифрами: 0 и 1. Поэтому минимальной единицей измерения данных является бит. Таким образом, 1 бит — это либо 0, либо 1. Элемент, принимающий всего два значения, называется двухпозиционным и просто реализуется аппаратно: например, двумя состояниями «включено» —«выключено», «ток есть» —«ток отсутствует».

Более подробно о системах счисления будет рассказано позже.

Наряду с битом используется укрупненная единица измерения — байт, равная 8 бит.При кодировании информации по Y разрядам с помощью X символов количество возможных различных комбинаций N определяется по формуле N=Xy(этосоотношение определяет число размещений с повторениями). При двоичном кодировании (Х=2) количество возможных различных комбинаций N определяется по формуле N=2Y.

Напомним таблицы размерностей:

1 бит - самая маленькая единица информации — условно один «О» или одна «1».

1 байт = 8 бит (8 = 23); в международной системе кодов ASCII (AmtricanStandardCodeforInformationInterchange, Американский стандартный код обмена информацией) каждый символ кодировался одним байтом, чтопозволяло закодировать  = 256 символов, чего на первых порах хватало. Сейчас происходит переход к кодировке Unicode, где каждый символ кодируется двумя байтами, что позволяет кодировать 216 = 65536 символов, многократно увеличивая возможности кодирования.

= 256 символов, чего на первых порах хватало. Сейчас происходит переход к кодировке Unicode, где каждый символ кодируется двумя байтами, что позволяет кодировать 216 = 65536 символов, многократно увеличивая возможности кодирования.

1 Кбайт (килобайт) = 1024 байт (210 байт). По этому поводу есть анекдот, что физик думает, что в одном килобайте 1000 байт, а программист - что в одном килограмме 1024 грамма.

1 Мбайт (мегабайт) = 1024 Кбайта (210 Кбайт или 220байт).

1 Гбайт (гигабайт)=1024 Мбайта (210 Мбайт или 230 байт).

1 Тбайт (терабайт)=1024 Гбайта (210 Гбайт или 240 байт).

В недалеком будущем нас ожидают:

1 Пбайт (петабайт) =1024 Тбайта (210 Тбайт или 250 байт).

1 Эбайт (экзабайт) =1024 Пбайта (210 Пбайт или 260 байт).

1 Збайт (зеттабайт) =1024 Эбайта (210 Эбайт или 270 байт).

1 Йбайт (йоттабайт) =1024 Збайта (210Збайт или 280 байт)

Пример 2.8. Сообщение в двоичной системе счисления 10010010 имеет объем данных V = 8 бит. Этот объем данных представляется 1 байтом.

Для удобства использования введены и более крупные единицы объема данных:

1 024 байт = 1 килобайт (Кбайт);

1 024 Кбайт = 1 мегабайт (Мбайт) = 1 0242 байт = 1048 576 байт;

1 024 Мбайт = 1 гигабайт (Гбайт) = 1 0243 байт;

1 024 Гбайт = 1 терабайт (Тбайт) = 1 0244 байт;

1 024 Тбайт = 1 пентабайт (Пбайт) = 1 0245 байт.

Общий объем информации в книгах, цифровых и аналоговых носителях за всю историю человечества составляет по оценкам 1018 байт. Зато следующие 1018 байт будут созданы в течение пяти —семи лет.

Отличие объема данных от количества информации заключается в следующем: объем данных выражается только целыми значениями, а количество информации — вещественными.

Формулу Хартли можно использовать для определения объема данных. При этом результат округляется в большую сторону, так как минимальной ячейкой памяти в ЭВМ является байт. Поэтому, заняв только часть байта (его несколько бит), оставшаяся часть байта не используется.

Пример 2.9. В сообщениях используются только первые шесть букв латинского алфавита: А, В, С, D, Е, F. Сколько байт необходимо для хранения сообщения «AABBCCD »?

Решение. Определим, сколько бит необходимо для хранения одной буквы по формуле Хартли:

= log26 = 2,58.

Результат округлим в большую сторону, следовательно:

= 3 бита.

Тремя битами можно представить 8 комбинаций: ООО, 001, 010, 011, 100, 101, 110, 111. Для кодирования шести букв используются первые шесть комбинаций, а две последние комбинации не используются.

Для сообщения, состоящего из М = 7 букв, необходимо

Vc = М*Vb = 7 • 3 = 21 бит = 2,625 байт.

Результат вновь округлим в большую сторону:

Vc = 3 байта.

Информатика и ее структура

Информатика — это наука и вид практической деятельности, связанные с процессами обработки информации с помощью вычислительной техники.

Термин «информатика» произошел от слияния двух французских слов information (информация) и automatique (автоматика) и дословно определял новую науку об «автоматической обработке информации». В англоязычных странах информатика называется computerscience (наука о компьютерной технике).

Информатика представляет собой единство разнообразных отраслей науки, техники и производства, связанных с переработкой информации с помощью вычислительной техники и телекоммуникационных средств связи в различных сферах человеческой деятельности.

Основная задача информатики заключается в определении общих закономерностей процессов обработки информации: создания, передачи, хранения и использования в различных сферах человеческой деятельности. Прикладные задачи связаны с разработкой методов, необходимых для реализации информационных процессов с использованием технических средств.

Информатика включает в себя следующие разделы.

I. Теоретическая информатика. Это часть информатики, включающая в себя ряд подразделов, тесно связанных с другой наукой — математикой. В теории информации и кодирования изучается информация как таковая, ее свойства, способы измерения количества информации. Областью исследования теории алгоритмов и автоматов являются методы переработки информации с помощью вычислительных систем. Теория формальных языков и грамматик рассматривает правила построения простейших языков с небольшим числом синтаксических конструкций, называемых языками программирования. Теория принятия решений и исследования операций связана с использованием информации для принятия решений и оценки их оптимальности. Теоретическая информатика использует математические методы для общего изучения процессов обработки информации.

II. Вычислительная техника. Это раздел, включающий в себя общие принципы построения вычислительных систем. Примером вычислительной системы является персональный компьютер, или ЭВМ. Этот раздел не связан с вопросами физической разработки, реализации и производства элементов вычислительных систем. Здесь рассматривается архитектура вычислительных систем — соглашение о составе, назначении, функциональных возможностях и принципах взаимодействия элементов внутри вычислительных систем и вычислительной системы с другими устройствами. Примерами принципиальных, ставших классическими решений в этой области являются архитектура фон Неймана компьютеров первых поколений, шинная архитектура ЭВМ, архитектура параллельной или многопроцессорной обработки информации.

III. Программирование. Это деятельность, направленная на разработку программного обеспечения вычислительной техники. Программирование делится на разделы, связанные с разработкой соответствующих типов программного обеспечения. Программное обеспечение, непосредственно управляющее составными частями вычислительной техники, называется системным. Системный уровень программного обеспечения составляют операционные системы. Служебное программное обеспечение — это архиваторы, антивирусы, программы управления файлами и папками. Служебное программное обеспечение предназначено для выполнения некоторых вспомогательных функций. Прикладное программное обеспечение — это программы для решения большинства задач пользователя. Прикладное программное обеспечение включает в себя офисные, графические, справочные программы, среды разработки программ и др.

IV. Информационные системы. Это раздел информатики, связанный с решением проблем анализа потоков информации в различных сложных системах, их оптимизации, структурировании, принципах хранения и поиска информации по запросу пользователя. Примерами информационных систем являются информационносправочные, информационно-поисковые, глобальные системы или сети хранения и поиска информации.

V. Искусственный интеллект. Это область информатики, в которой решаются сложнейшие проблемы, находящиеся на пересечении с психологией, физиологией, языкознанием и другими науками. Исторически сложились три основных направления развития систем искусственного интеллекта. Целью работ первого направления является создание алгоритмического и программного обеспечения вычислительных машин, позволяющего решать интеллектуальные задачи не хуже человека. В рамках второго подхода объектом исследований являются структура и механизмы работы мозга человека, а конечная цель заключается в моделировании функционирования.