Имеются две генеральные совокупности Х и У, имеющие трехмерный нормальный закон распределения с неизвестными, но равными ковариационными матрицами.

Алгоритм выполнения дискриминантного анализа включает основные этапы:

1. Исходные данные представляются либо в табличной форме в виде q подмножеств (обучающих выборок) Mk и подмножества М 0 объектов подлежащих дискриминации, либо сразу в виде матриц X (1), X (2),..., X (q), размером (nk × p):

Таблица 1

| Номер подмножества Mk (k = 1, 2,..., q) | Номер объекта, i (i = 1, 2,..., nk) | Свойства (показатель), j (j = 1, 2,..., p) | |||

| x 1 | x 2 | … | x 0 | ||

| Подмножество M 1 (k = 1) |

|

| … |

| |

|

| … |

| ||

| … | … | … | … | … | |

| n 1 |

|

| … |

| |

| Подмножество M 2 (k = 2) |

|

| … |

| |

|

| … |

| ||

| … | … | … | … | … | |

| n 2 |

|

| … |

| |

| … | … | … | … | … | … |

| Подмножество Mq (k = q) |

|

| … |

| |

|

| … |

| ||

| … | … | … | … | … | |

| nq |

|

| … |

| |

| Подмножество M 0, подлежащее дискриминации |

|

| … |

| |

|

| … |

| ||

| … | … | … | … | … | |

| m |

|

| … |

|

где X(k) - матрицы с обучающими признаками (k = 1, 2,..., q),

X (0) матрица новых m -объектов, подлежащих дискриминации (размером m × p),

р — количество свойств, которыми характеризуется каждый i -й объект.

Здесь должно выполняться условие: общее количество объектов N множества М должно быть равно сумме количества объектов m (в подмножестве M 0), подлежащих дискриминации, и общего количества объектов  в обучающих подмножествах:

в обучающих подмножествах:  , где q - количество обучающих подмножеств (q ≥2). В реальной практике наиболее часто реализуется случай q =2, поэтому и алгоритм дискриминантного анализа приведен для данного варианта.

, где q - количество обучающих подмножеств (q ≥2). В реальной практике наиболее часто реализуется случай q =2, поэтому и алгоритм дискриминантного анализа приведен для данного варианта.

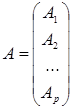

2. Определяются  элементы векторов

элементы векторов  средних значений по каждому j -му признаку для i объектов внутри k -го подмножества (k = 1, 2):

средних значений по каждому j -му признаку для i объектов внутри k -го подмножества (k = 1, 2):

Результаты расчета представляются в виде векторов столбцов  :

:

3. Для каждого обучающего подмножества рассчитываются ковариационные матрицы S(k) (размером p × p):

4. Рассчитывается объединенная ковариационная матрица  по формуле:

по формуле:

5. Рассчитывается матрица  обратная к объединенной ковариационной матрице

обратная к объединенной ковариационной матрице  :

:

где |  |— определитель матрицы

|— определитель матрицы  , (причем

, (причем  ),

),  - присоединенная матрица, элементы которой являются алгебраическими дополнениями элементов матрицы

- присоединенная матрица, элементы которой являются алгебраическими дополнениями элементов матрицы  .

.

6. Рассчитывается вектор-столбец  дискриминантных множителей с учетом всех элементов обучающих подмножеств по формуле:

дискриминантных множителей с учетом всех элементов обучающих подмножеств по формуле:

Данная расчетная формула получена с помощью метода наименьших квадратов из условия обеспечения наибольшего различия между дискриминантными функциями. Наилучшее разделение двух обучающих подмножеств обеспечивается сочетанием минимальной внутригрупповой вариации и максимальной межгрупповой вариации.

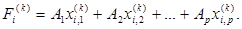

7. По каждому i -му объекту (i = 1, 2,..., N) множества М определяется соответствующее значение дискриминантной функции:

8. По совокупности найденных значений F(k) рассчитываются средние значения для каждого подмножества Mk:

9. Определяется общее среднее (константа дискриминации) для дискриминантных функций

10. Выполняется распределение (дискриминация) объектов подмножества М 0 подлежащих дискриминации по обучающим выборкам М 1 и М 2. С этой целью рассчитанные и п. 7 по каждому i -му объекту значения дискриминантных функций

сравниваются с величиной  общего среднего. На основе сравнения данный объект относят к одному из обучающих подмножеств.

общего среднего. На основе сравнения данный объект относят к одному из обучающих подмножеств.

Если  , то i -й объект подмножества М 0 относят к подмножеству М 1, при

, то i -й объект подмножества М 0 относят к подмножеству М 1, при  >0 и к подмножеству М 2 при

>0 и к подмножеству М 2 при  <0. Если же

<0. Если же  <

<  , то заданный объект относят к подмножеству М 1, при

, то заданный объект относят к подмножеству М 1, при  < 0 и к подмножеству М 2 в противном случае.

< 0 и к подмножеству М 2 в противном случае.

11. Далее делается оценка качества распределения новых объектов, для чего оценивается вклад переменных в дискриминантную функцию.

Влияние признаков на значение дискриминантной функции и результаты классификации может оцениваться по дискриминантным множителям (коэффициентам дискриминации), по дискриминантным нагрузкам признаков или по дискриминантной матрице.

Дискриминантные множители зависят от масштабов единиц измерения признаков, поэтому они не всегда удобны для оценки.

Дискриминантные нагрузки более надежны в оценке признаков, они вычисляются как парные линейные коэффициенты корреляции между рассчитанными уровнями дискриминантной функции F и признаками, взятыми для ее построения.

Дискриминантная матрица характеризует меру соответствия результатов классификации фактическому распределению объектов по подмножествам и используется для оценки качества анализа. В этом случае дискриминантная функция F формируется по данным объектов (с измеренными p признаками) обучающих подмножеств, а затем проверяется качество этой функции путем сопоставления фактической классовой принадлежности объектов с той, что получена в результате формальной дискриминации.