В разделах 4.1 и 4.2 мы рассмотрели организационную систему, состоящую из одного центра и одного агента, и решили для этой простейшей модели задачу стимулирования, в которой целевая функция центра представляла собой разность между доходом и затратами на стимулирование, выплачиваемыми агенту. Мы доказали, что оптимальной является компенсаторная система стимулирования, которая имеет следующий вид: агент получает вознаграждение, равное затратам, в случае выполнения плана и вознаграждение, равное нулю, во всех остальных случаях. Оптимальный план определялся как план, максимизирующий разность между доходом центра и затратами агента.

Давайте эту же задачу стимулирования с той же содержательной интерпретацией попробуем «продолжить» дальше и решить ее для более сложных случаев. Например, для системы, состоящей из нескольких агентов, подчиненных одному центру (рис. 4.4).

Как отмечалось в первой лекции, любая организационная система (точнее ее модель) описывается следующими параметрами: состав, структура, целевые функции, допустимые множества и информированность. Состав рассматриваемой системы понятен: центр и n агентов; структура представлена на рис. 4.4 - все агенты на нижнем уровне, центр на верхнем уровне, всего уровней иерархии два. Целевые функции и допустимые множества:

.

.

Будем считать, что i -ый агент выбирает действие yi из множества Ai, центр выбирает стимулирование i -го агента  , которое зависит от действия, которое выбирает i -й агент, где i принадлежит множеству агентов N.

, которое зависит от действия, которое выбирает i -й агент, где i принадлежит множеству агентов N.

Целевая функция центра представляет собой разность между доходом H (y), который он получает от деятельности агентов, где  – вектор действий всех агентов, и суммарным стимулированием, выплачиваемым агентам, то есть суммой по всем агентам тех вознаграждений, которые он им выплачивает:

– вектор действий всех агентов, и суммарным стимулированием, выплачиваемым агентам, то есть суммой по всем агентам тех вознаграждений, которые он им выплачивает:  .

.

|

|

Мы обобщили предыдущую более простую модель: целевая функция агента имеет тот же вид, только появляется индекс i. И таких целевых функций n штук, то есть i- ый агент получает стимулирование за свои действия от центра и несет затраты, зависящие только от его собственных действий:

.

.

Сравним целевую функцию в предыдущей модели и целевую функцию, которая записана для веерной структуры с несколькими агентами. Стимулирование i -го агента зависит только от его собственных действий, затраты тоже зависят только от его собственных действий и целевая функция i -го агента зависит только от его стимулирования и от его собственных действий, то есть агенты между собой, фактически, не связанны. Итак, полноценной игры между агентами нет, потому что тот выигрыш, который получает любой агент, зависит только от того, что делает он сам и не зависит от того, что делают остальные.

Эта сложная система может быть разбита на n подсистем, каждая из которых имеет вид, приведенный на рис. 2.1, и рассматривать их можно, в принципе, независимо. Применим для каждой из них по отдельности результат утверждений 4.1 и 4.2.

Из результатов анализа одноэлементной модели известно, что каждого из агентов можно стимулировать независимо, и каждому из них достаточно компенсировать затраты. Поэтому задачу можно решить так: известно, что доход центра будет H(y), и заплатить он должен i -му агенту за выбор действия yi ровно ci (yi). Подставляем оптимальную систему стимулирования в целевую функцию центра, получаем разность  . Ищем оптимальный план, который будет максимизировать целевую функцию центра на множестве допустимых векторов действия агентов:

. Ищем оптимальный план, который будет максимизировать целевую функцию центра на множестве допустимых векторов действия агентов:

|

|

.

.

Это - оптимизационная задача, и проблем с формальным решением этой задачи обычно не возникает.

Давайте посмотрим еще раз на полученный результат. Каким образом будет принимать решение отдельный агент? Его целевая функция зависит только от его собственного действия, и при известной системе стимулирования, сообщенной ему центром, он будет решать задачу выбора своего собственного действия, которое будет максимизировать его целевую функцию - разность между вознаграждением и затратами. Т.к. его целевая функция зависит только от его собственного действия, то выбираемое им действие не будет зависеть от того, что делают остальные агенты. В этом смысле агенты независимы, то есть у каждого есть доминантная стратегия. Получилось, что число агентов возросло, а никакого качественно нового эффекта не появилось - можно рассматривать взаимодействие между центром и агентами независимо. Поэтому продолжим усложнение модели.

Первым шагом усложнения будет введение ограничения на фонд заработной платы, потому что иначе агенты ничем не объединены. Такие организационные системы называются системами со слабо связанными агентами. Поэтому добавим ограничение фонда заработной платы R:  . То есть наложим на стимулирование ограничение, что сумма вознаграждений, которые выплачиваются агентам, должна быть не больше, чем некоторая известная величина, которую содержательно можно интерпретировать как фонд заработной платы.

. То есть наложим на стимулирование ограничение, что сумма вознаграждений, которые выплачиваются агентам, должна быть не больше, чем некоторая известная величина, которую содержательно можно интерпретировать как фонд заработной платы.

|

|

Посмотрим, что при этом изменится. Поведение агентов не изменится, потому что целевая функция каждого агента зависит только от его собственных действий. Изменится задача, которую должен решать центр. Центр знает, что при использовании оптимальной системы стимулирования он должен компенсировать затраты каждому агенту, но теперь у него есть дополнительное ограничение, и он должен проводить максимизацию не по всем векторам действий агентов, а только по тем из них, которые будут удовлетворять бюджетному ограничению. Задача меняется - нужно проводить максимизацию по множеству A' в пересечении с множеством таких векторов действий y, что сумма  , то есть, выполнено бюджетное ограничение.

, то есть, выполнено бюджетное ограничение.

С точки зрения центра по прежнему оптимально каждому из агентов компенсировать затраты на выполнение плана, то есть структура системы стимулирования сохраняется. Целевая функция агентов, по-прежнему, зависит только от системы стимулирования, которую задал центр, и от действия данного агента. И агента не волнует наличие бюджетного ограничения, он производит свой выбор при сообщенной ему системе стимулирования. Получили задачу условной оптимизации:

.

.

Все, задача стимулирования решена - она сведена к задаче условной оптимизации. Рассмотрим пример.

Пример 4.1. Пусть имеются два агента (n = 2), функция дохода центра представляет собой сумму действия агентов: H(y)=y1+y2. Функция затрат i -го агента является квадратичной:

,

,

где константа ri >0 может интерпретироваться как эффективность деятельности агента, его квалификация - чем больше квалификация, тем меньше затраты.

Целевая функция центра при использовании компенсаторной системы стимулирования - это сумма действий агентов минус сумма их затрат. Ее можно максимизировать по  и

и  при ограничении, что сумма компенсируемых затрат не больше, чем фонд заработной платы:

при ограничении, что сумма компенсируемых затрат не больше, чем фонд заработной платы:

Задача стимулирования сводится к определению двух параметров: y 1 и y 2. Найдем эти параметры:

Это безусловный максимум целевой функции: если продифференцировать по y 1, то получим 1– y 1/ r 1. Затраты первого агента равны r 1/2. Значит, если  , то оптимальное решение – x 1= r 1, x 2= r 2. Если

, то оптимальное решение – x 1= r 1, x 2= r 2. Если  , то бюджетное ограничение становится существенным и тогда можно пользоваться методом множителей Лагранжа.

, то бюджетное ограничение становится существенным и тогда можно пользоваться методом множителей Лагранжа.

Запишем лагранжиан:

.

.

Дифференцируя его по y1, получаем:  . Приравнивая нулю, находим оптимальное действие в зависимости от множителя Лагранжа. Следовательно,

. Приравнивая нулю, находим оптимальное действие в зависимости от множителя Лагранжа. Следовательно,  . Аналогично

. Аналогично  . Подставляем в бюджетное ограничение, которое выполняется как равенство:

. Подставляем в бюджетное ограничение, которое выполняется как равенство:  . Откуда

. Откуда  . Следовательно, оптимальное решение будет иметь следующий вид

. Следовательно, оптимальное решение будет иметь следующий вид  , i =1,2.

, i =1,2.

Итак, если фонд заработной платы меньше чем полусумма констант r 1 и r 2, то оптимально назначать планы x 1= r 1, x 2= r 2; если фонд заработной платы больше полусуммы r 1 и r 2, то оптимальны планы  , i =1,2. Обратите внимание, что решение получилось непрерывным, т.е. при R, равном полусумме r 1 и r2, решения «состыковываются».

, i =1,2. Обратите внимание, что решение получилось непрерывным, т.е. при R, равном полусумме r 1 и r2, решения «состыковываются».

Отметим, что, рассматривая задачу стимулирования слабо связанных агентов, на самом деле 99 % процентов времени мы потратили на решение задачи согласованного планирования, то есть на решение соответствующей задачи условной оптимизации, которая к управлению «никакого отношения не имеет», потому что мы воспользовались готовым результатом, что в оптимальной компенсаторной функции стимулирования вознаграждение в точности равно затратам, и при ней агенты будут выполнять план.

Будем усложнять задачу дальше. Логика была такая: от одноэлементной системы перейти к такой, где все агенты были независимы и ограничений не было, затем добавить ограничение на фонд заработной платы. Предположим теперь, что агенты сильно связаны, и эту связь будем отражать следующим образом: предположим, что затраты каждого агента зависят не только от его собственных действий, но и от действий других агентов. Соответственно вознаграждение каждого агента будет зависеть от действий всех агентов.

Целевая функция центра:

,

,

где y=(y1,…,yn), целевые функции агентов:

Мы предположили, что на нижнем уровне агенты взаимодействуют таким образом, что затраты каждого зависят от вектора действий всех, и вознаграждение каждого, в общем случае, зависит от вектора действий всех. Это сильно осложняет дело, так как непосредственно воспользоваться результатом анализа одноэлементной модели уже невозможно.

Давайте формулировать задачу управления. Как агенты будут принимать решения? Первый ход делает центр: сообщает им систему стимулирования, то есть каждому агенту говорит зависимость вознаграждения от вектора действий всех агентов. Агенты это узнали, дальше они должны выбирать действия. Если выигрыш каждого зависит от действий всех, значит, имеет место игра. Исходом игры является ее равновесие, например, равновесие Нэша. Обозначим вектор-функцию стимулирования  , и запишем равновесие игры агентов в зависимости от системы стимулирования, которую использует центр:

, и запишем равновесие игры агентов в зависимости от системы стимулирования, которую использует центр:

.

.

Теперь сформулируем задачу управления:

Целевая функция центра зависит от функции стимулирования и от действий агентов. Агенты при фиксированной функции стимулирования выберут действия, являющиеся равновесием Нэша их игры. Возьмем гарантированный результат целевой функции центра по множеству равновесий Нэша игры агентов при заданной системе стимулирования. Эта конструкция будет уже зависеть только от функции стимулирования. Дальше нужно ее максимизировать выбором вектор-функции стимулирования, то есть центр должен найти такой набор стимулирований агентов, который бы максимизировал гарантированное значение его целевой функции на множестве равновесий Нэша игры агентов.

Вид этой задачи почти такой же, как и одноэлементной, только раньше (в одноэлементной системе) не было суммы и было множество максимумов целевой функции единственного агента. В многоэлементной системе вместо множества максимумов целевой функции агента появляется множество равновесий Нэша, и появляется сумма стимулирований агентов. Задача сложнá, так как мы сначала должны взять минимум некоторого функционала по множеству, которое зависит от вектор-функции, которая входит в этот функционал, а потом минимизировать выбором вектор-функции.

Если посмотреть на определение множества равновесий Нэша, то увидим, что это множество зависит от вектор-функции и определяется бесконечной системой неравенств. При решении сложных задач важно угадать решение. Решение этой задачи угадывалось достаточно долго - около 15 лет (сформулировали ее в 1984 году, а решение нашли в 1998). Идея на самом деле очень простая: если в одноэлементной задаче есть компенсаторная система стимулирования - простая и понятная, то какую надо придумать компенсаторную систему стимулирования для решения многоэлементной задачи?

Затраты агента зависят от того, что делает он сам, и от действий всех остальных агентов. Центр говорит: «выполняй план, обещаю компенсировать фактические затраты по выполнению плана, независимо от того, что сделают остальные агенты» (принцип декомпозиции - см. выше):

,

,  .

.

Убедимся, что при такой системе стимулирования выполнение плана является равновесием Нэша. Для этого надо подставить эту систему стимулирования в определение равновесия Нэша и доказать, что вектор x является равновесием Нэша. При выполнении плана i -ый агент получает компенсацию затрат, и несет такие же затраты. В случае невыполнения плана он получает нулевое вознаграждение и несет какие-то затраты:

.

.

Получили выражение «минус затраты меньше нуля». Это неравенство будет выполняться при любых обстановках, то есть каждому агенту выгодно выполнять план, независимо от того, что делают другие. Вспомним, что доминантная стратегия агента - это такое его действие, которое доставляет максимум целевой функции, независимо от действий остальных агентов. В данном случае выполнение плана будет максимизировать целевую функцию агента независимо от действий остальных, то есть выполнение плана будет равновесием в доминантных стратегиях.

Итак, мы доказали, что предложенная компенсаторная система стимулирования реализует заданный вектор планов как равновесие в доминантных стратегиях игры агентов. Можно ли заставить агентов выбрать какой-либо вектор действий как равновесие их игры, и заплатить им в сумме меньше, чем сумма их затрат (целевая функция центра зависит от суммы стимулирований с минусом, хотелось бы эту сумму минимизировать). Штрафы центр не может накладывать, так как стимулирование неотрицательное (может наказать, только ничего не платя). Можно ли неотрицательным стимулированием побудить агентов выбрать какой-то вектор действий, и заплатить им сумму меньше, чем сумма их затрат. Утверждается, что нет!

Введем предположение, что затраты агента в случае выбора им нулевого действия равны ноль, независимо от того, что делают остальные:  .

.

Целевая функция каждого агента - вознаграждение минус затраты. Фиксируем некоторый вектор действий, который центр хочет от агентов добиться. Если сумма стимулирований по реализации этого вектора меньше чем сумма затрат агентов, то это значит, что найдется хотя бы один агент, у которого вознаграждение будет меньше затрат, что противоречит предположению о неотрицательности затрат и возможности каждого агента обеспечить себе нулевые затраты выбором нулевого действия.

Значит, помимо того, что компенсаторная система стимулирования реализует вектор планов как равновесие в доминантных стратегиях игры агентов, при этом центр платит минимально возможную величину. Значит, эта система стимулирования оптимальна. Осталось найти, каким должен быть вектор планов. Также как и в одноэлементной модели, нужно в целевую функцию центра подставить вместо стимулирования затраты агентов и минимизировать полученное выражение выбором плана:

.

.

То есть, нужно найти такое допустимое действие, которое максимизировало бы прибыль центра, и назначить это действие в качестве плана, подставив ее в систему стимулирования. Задача решена!

Обратите внимание, что здесь, как и в одноэлементной модели, как и в системе со слабо связанными агентами, имея результат об оптимальности компенсаторных систем стимулирования, дальше решаем только задачу планирования. В данном случае доказательство оптимальности декомпозирующей системы стимулирования было сложнее, чем в одноэлементной системе, потому что имеет место игра агентов. Но мы угадали решение, и эту игру как бы «декомпозировали на части», то есть за счет управления центр декомпозировал взаимодействие агентов. Использование таких управлений, которые декомпозируют взаимодействие агентов, превращают их игру в игру, в которой существует равновесие в доминантных стратегиях, называется принцип декомпозиции игры агентов.

Распределенный контроль

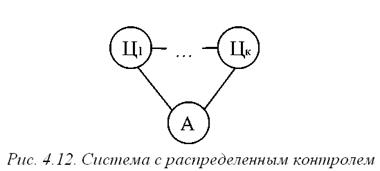

Усложним задачу дальше. Решим задачу управления для структуры, приведенной на рис. 4.12. Такие структуры называются системами с распределенным контролем. Это - перевернутая веерная структура, в которой один агент подчинен нескольким начальникам.

Ситуация достаточно распространена, в частности, в проектном управлении: агент, который работает по какому-то проекту, подчинен руководителю проекта; в то же время, он работает в подразделении и подчинен соответствующему функциональному руководителю. Или преподаватель работает на кафедре, а его приглашают читать лекции на другую кафедру или факультет.

Система с распределенным контролем характеризуется тем, что, если в веерной структуре имела место игра агентов, то в этой структуре имеет место игра центров. Если добавить сюда еще нескольких агентов, каждый из которых подчинен разным центрам, то получится игра и тех, и других на каждом уровне (см. рис. 2.2д). Опишем модель, которая сложнее рассмотренной выше многоэлементной системы, так как, если игра агентов заключается в выборе действий, а действием был скаляр, то игра центров заключается в выборе функций стимулирования агента, зависящих от его действий, то есть в игре центров стратегией каждой из них является выбор функции. Целевые функции центров имеет следующий вид:

;

;

и представляют собой разность между доходом и стимулированием, выплачиваемым агенту, где К- множество центров.

Целевая функция агента:  , то есть он получает стимулирования от центров, которые суммируются, и несет затраты.

, то есть он получает стимулирования от центров, которые суммируются, и несет затраты.

Предположим, что действия агента принадлежат множеству, которое будет уже не отрезком действительной оси (часы, шт. и т.д.), а может быть многомерным множеством (отражать разные виды деятельности), тогда функция затрат будет отображать множество действий во множество действительных чисел.

Определим множество выбора агента - множество максимумов его целевой функции в зависимости от стимулирования со стороны

центров:  .

.

Поведение агента понятно: в зависимости от вектора стимулирований агент будет выбирать действие, которое будет максимизировать его целевую функцию, представляющую собой разность между его суммарным вознаграждением и затратами.

Тогда центры должны решить, какое стимулирование назначать агенту. Причем, каждый должен решить сам, как ему управлять подчиненным, что ему обещать. Центры оказываются «завязанными» на одного подчиненного, и что он будет делать, зависит от того, что ему предложит каждый из центров.

Каждый из центров не может рассуждать по отдельности, то есть, если он попросит от агента что-то сделать, то тот не обязательно это сделает, так как другой центр может попросить от него другого и пообещает заплатить больше. Таким образом, центры вовлечены в игру и должны прийти к равновесию, подбирая соответствующие функции стимулирования и прогнозируя, какие действия в ответ на вектор стимулирований будет выбирать агент.

Задача достаточно громоздка, поэтому приведем несколько известных результатов, которые позволяют ее упростить.

Первый результат говорит следующее: если рассматривается игра центров, то в теории игр принято использовать два подхода: равновесие Нэша и эффективность по Парето. В системе с распределенным контролем множество равновесий Нэша пересекается с множеством Парето, то есть можно из множества равновесий Нэша выбрать такое, которое является эффективным по Парето. Есть теорема, которая гласит, что существует класс простых функций стимулирования, которые гарантируют Парето-эффективность равновесия Нэша игры центров. Эти функции стимулирования имеют компенсаторный вид:  ,

,  .

.

Содержательно эта система стимулирования значит, что существует некоторое действие агента (план x), относительно которого центры договорились выплачивать агенту стимулирование в случае, если он выберет это действие. При этом i -ый центр платит  за выполнение плана. В случае, если агент выполняет другое действие, то он не получает вознаграждения вовсе. Таким образом, этот результат позволяет нам перейти от игры центров, в которой стратегией каждого является выбор функции, к игре, в которой стратегией является выбор одного действия агента и размера вознаграждения. Причем, относительно вектора вознаграждений можно сказать следующее: посмотрим на целевую функцию агента: он получает сумму вознаграждений и несет какие-то затраты. Если затраты в нуле равны нулю, то с точки зрения агента сумма стимулирований должна быть не меньше, чем затраты:

за выполнение плана. В случае, если агент выполняет другое действие, то он не получает вознаграждения вовсе. Таким образом, этот результат позволяет нам перейти от игры центров, в которой стратегией каждого является выбор функции, к игре, в которой стратегией является выбор одного действия агента и размера вознаграждения. Причем, относительно вектора вознаграждений можно сказать следующее: посмотрим на целевую функцию агента: он получает сумму вознаграждений и несет какие-то затраты. Если затраты в нуле равны нулю, то с точки зрения агента сумма стимулирований должна быть не меньше, чем затраты:  .

.

С другой стороны, Парето-эффективными с точки зрения центров являются такие размеры вознаграждений, которые нельзя уменьшить, не изменив действия агента. Значит, сумма вознаграждений должна быть в точности равна затратам агента.

Пользуясь этим результатом, охарактеризуем равновесие игры центров, то есть найдем такие условия, при которых они договорятся, чего хотят добиться от агента. Для этого рассчитаем следующие величины:  .

.

Если i -ый центр сам взаимодействует (работает в одиночку) с агентом, то он будет использовать компенсаторную систему стимулирования, и прибыль, которую он получит, будет равна величине Wi (это следует из решения одноэлементной задачи - см. выше).

Запишем условия того, что каждому центру будет выгодно взаимодействовать с другими центрами (совместно управлять агентом), по сравнению с индивидуалистическим поведением, когда он говорит: пусть подчиненный работает только на меня. Запишем это условие следующим образом:  . В случае если центры взаимодействуют друг с другом, i -ый центр получает доход Hi (x) от выбора агентом действия x и платит агенту

. В случае если центры взаимодействуют друг с другом, i -ый центр получает доход Hi (x) от выбора агентом действия x и платит агенту  . При этом значение его целевой функции должно быть не меньше, чем если бы он взаимодействовал с агентом в одиночку, что дало бы ему полезность Wi. Кроме того, должно быть выполнено условие равенства суммы вознаграждений агента его затратам. Обозначим:

. При этом значение его целевой функции должно быть не меньше, чем если бы он взаимодействовал с агентом в одиночку, что дало бы ему полезность Wi. Кроме того, должно быть выполнено условие равенства суммы вознаграждений агента его затратам. Обозначим:

- множество действий агента и векторов выплат его деятельности со стороны центров, таких, что сумма этих выплат в точности равна затратам агента по реализации этого действия, и каждый из центров получает выигрыш, не меньший, чем если бы он действовал в одиночку. Эта область представляет собой подмножество декартова произведения множества A на k -мерный положительный ортант.

- множество действий агента и векторов выплат его деятельности со стороны центров, таких, что сумма этих выплат в точности равна затратам агента по реализации этого действия, и каждый из центров получает выигрыш, не меньший, чем если бы он действовал в одиночку. Эта область представляет собой подмножество декартова произведения множества A на k -мерный положительный ортант.

Множество  есть множество компромисса для системы с распределенным контролем. Она содержательно похожа на область компромисса в игре одного центра и одного агента.

есть множество компромисса для системы с распределенным контролем. Она содержательно похожа на область компромисса в игре одного центра и одного агента.

Утверждение 4.3.

1) Если область компромисса  не пуста, то имеет место сотрудничество центров: центры могут договориться, какой вектор действия агенту выбирать и кто сколько должен заплатить;

не пуста, то имеет место сотрудничество центров: центры могут договориться, какой вектор действия агенту выбирать и кто сколько должен заплатить;

2) Возможна ситуация, когда эта область  пуста. Тогда это будет ситуация конкуренции центров.

пуста. Тогда это будет ситуация конкуренции центров.

В случае конкуренции исходом игры центров в содержательном смысле будет следующее: начальники между собой не договорились, как использовать подчиненного. Тогда первый начальник считает, что бы он хотел получить от подчиненного, действуя в одиночку. Аналогично поступают остальные. Каждый из начальников говорит подчиненному: «Давай ты будешь работать на меня – я тебе плачу столько-то». Начинает он с компенсации затрат. Каждый сказал, подчиненный сидит на нуле. Кто-то из начальников догадывается и говорит: «я тебе оплачу затраты и еще надбавку при условии, что ты будешь работать на меня». Это лучше для подчиненного, так как он получает не ноль, а что-то сверх компенсации затрат. Начинается конкуренция центров, каждый центр «перетягивает» на себя агента. В такой ситуации наилучшее положение – у агента. Из центров победит тот, у которого больше значение Wi, то есть параметр, характеризующий прибыль, которую получает центр от действий агента. Кто более эффективно взаимодействует с агентом, тот его и «переманит».

Если упорядочить центров в порядке убывания Wi:  , то победит тот, у кого Wi максимально, заплатив агенту, помимо компенсации затрат, W 2 плюс бесконечно малую величину, чтобы переманить агента у (второго в данном упорядочении) центра.

, то победит тот, у кого Wi максимально, заплатив агенту, помимо компенсации затрат, W 2 плюс бесконечно малую величину, чтобы переманить агента у (второго в данном упорядочении) центра.

Ситуация упорядочения центров по эффективности, когда побеждает тот, кто обладает максимальной эффективностью, причем побеждает по цене следующего за ним, называется аукционным решением (аукцион второй цены).

Найдем условия существования режима сотрудничества. Введем следующую величину: максимум суммарного выигрыша центров, то есть определим действие агента, которое доставляет максимум суммы доходов центров минус затраты агента:

Утверждение 4.4. Режим сотрудничества может быть реализован, то есть область компромисса не пуста, тогда и только тогда, когда сумма индивидуальных выигрышей центров от их деятельности по отдельности не больше, чем суммарный выигрыш системы при совместном взаимодействии центров:  .

.

Содержательная интерпретация утверждения 4.4 следующая: у системы должно существовать свойство эмерджентности (целое больше, чем сумма частей). В данном случае целое - сотрудничество центров - должно быть больше, чем сумма частей. То есть, если в системе присутствует синергетический эффект, то центры смогут прийти к компромиссу.

Лекция 5. Механизмы планирования в организационных системах

В настоящей лекции мы, так же, как и в предыдущей, будем рассматривать задачи мотивационного управления (в них управляющее воздействие направлено на целевые функции управляемых агентов). А именно, будем изучать класс задач, который условно называется механизмами планирования. Термин «планирование» употребляется в двух смыслах. Во-первых, план это – образ действий. В более узком смысле план это желательное с точки зрения центра состояние системы. Под механизмом планирования в теории управления понимается несколько более узкая вещь, а именно процедура определения планов в зависимости от сообщений агентов. Зачем же нужны сообщения агентов?