Основной причиной наличия случайного члена в модели являются несовершенные знания о причинах и взаимосвязях, определяющих то или иное значение зависимой переменной. Поэтому свойства случайных отклонений, в том числе и автокорреляция, в первую очередь зависят от выбора формулы зависимости и состава объясняющих переменных. Так как автокорреляция чаще всего вызывается неправильной спецификацией модели, то для ее устранения необходимо, прежде всего, попытаться скорректировать саму модель. Возможно, автокорреляция вызвана отсутствием в модели некоторой важной объясняющей переменной. Необходимо попытаться определить данный фактор и учесть его в уравнении регрессии. Также можно попробовать изменить формулу зависимости (например, линейную на лог-линейную, линейную на гиперболическую и т. д.). Однако если все разумные процедуры изменения спецификации модели. на ваш взгляд, исчерпаны, а автокорреляция имеет место, то можно предположить, что она обусловлена какими-то внутренними свойствами ряда {ет}. В этом случае можно воспользоваться авторегрессионным преобразованием. В линейной регрессионной модели либо в моделях, сводящихся к линейной, наиболее целесообразным и простым преобразованием является авторегрессионная схема первого порядка AR(1).

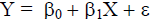

Для простоты изложения AR(1) рассмотрим модель парной линейной регрессии

(4.1)

(4.1)

Тогда наблюдениям t и (t-1) соответствуют формулы

(4.2)

(4.2)

(4.3)

(4.3)

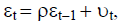

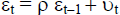

Пусть случайные отклонения подвержены воздействию авторегресси первого порядка:

где vt,t=2,3…T- случайные отклонения, удовлетворяющие всем предпосылкам МНК, а коэффициент р известен.

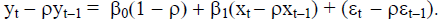

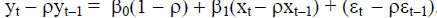

Вычтем из (4.2) соотношение (4.3),умножив на  :

:

(4.4)

(4.4)

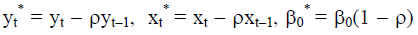

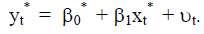

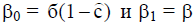

Положив  , получим:

, получим:

Так как по предположению коэффициент р известен, то очевидно,  вычисляются достаточно просто. В силу того, что случайные отклонения

вычисляются достаточно просто. В силу того, что случайные отклонения  удовлетворяют предпосылкам МНК, то оценки

удовлетворяют предпосылкам МНК, то оценки  и

и  будут обладать свойствами наилучших линейных несмещенных оценок.

будут обладать свойствами наилучших линейных несмещенных оценок.

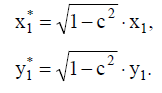

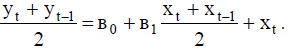

Однако способ вычисления y, х приводит к потере первого наблюдения (если мы не обладаем предшествующим ему наблюдением). Число степеней свободы уменьшится на единицу, что при больших выборках не так существенно, но при малых выборках может привести к потере эффективности. Эта проблема обычно преодолевается с помощью поправки Прайса-Виистена:

(4.5)

(4.5)

4.1. Определение  на основе статистики Дарбина-Уотсона

на основе статистики Дарбина-Уотсона

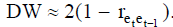

Статистика Дарбина-Уотсона тесно связана с коэффициентом корреляции между соседними отклонениями через соотношение:

(4.1.1)

(4.1.1)

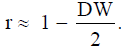

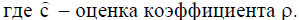

Тогда в качестве оценки коэффициента  может быть взят коэффициент

может быть взят коэффициент  . Из (5.1.1) имеем:

. Из (5.1.1) имеем:

(4.1.2)

(4.1.2)

Этот метод оценивания весьма неплох при большом числе наблюдений. В этом случае оценка r параметра  будет достаточно точной.

будет достаточно точной.

Метод Кохрана- Оркатта

Другим возможным методом оценивания  является итеративный процесс, называемый методом Кохрана- Оркатта. Опишем данный метод на примере парной регрессии:

является итеративный процесс, называемый методом Кохрана- Оркатта. Опишем данный метод на примере парной регрессии:

И авторегрессионной схемы первого порядка AR(1)

1. Оценивается по МНК регрессия и для нее определяются оценки  отклонений

отклонений  t=1,2,…n.

t=1,2,…n.

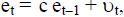

2. Используя схему AR(1), оценивается регрессионная зависимость

(4.2.1)

(4.2.1)

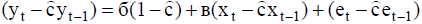

3. На основе данной оценки строится уравнение:

(4.2.2)

(4.2.2)

с помощью которого оцениваются коэффициенты  и

и  (в этом случае значение

(в этом случае значение  известно).

известно).

4. Значения  подставляются в уравнение регрессии. Вновь вычисляются оценки отклонений и процесс возвращается к этапу 2.

подставляются в уравнение регрессии. Вновь вычисляются оценки отклонений и процесс возвращается к этапу 2.

Чередование этапов осуществляется до тех пор, пока не будет достигнута требуемая точность. То есть пока разность между предыдущей и последующей оценками не станет меньше любого наперед заданного числа.

Метод Хилдрета-Лу

По данному методу регрессия

оценивается для каждого возможного значения  из интервала [-1;1] с любым шагом (например, 0,001;0,01 и т.д.). Величина

из интервала [-1;1] с любым шагом (например, 0,001;0,01 и т.д.). Величина  , дающая наименьшую стандартную ошибку регрессии, принимается в качестве оценки коэффициента

, дающая наименьшую стандартную ошибку регрессии, принимается в качестве оценки коэффициента  . И значение

. И значение  и

и  оценивается из уравнения регрессии именно с данным значением

оценивается из уравнения регрессии именно с данным значением  .

.

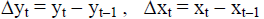

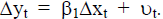

Метод первых разностей

В случае, когда есть основания считать, что автокорреляция отклонений очень велика, можно использовать метод превых разностей.

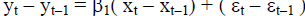

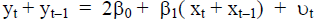

Для временных рядов характерна положительная автокорреляция остатков. Поэтому при высокой автокорреляции полагают  ,и, следовательно, уравнение (4.4) принимает вид:

,и, следовательно, уравнение (4.4) принимает вид:

(4.4.1)

(4.4.1)

Или

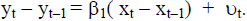

Обозначив  из (4.4.1) получим

из (4.4.1) получим

(4.4.2)

(4.4.2)

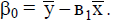

Из уравнения (4.4.2) по МНК оценивается коэффициент  .Заметим, что коэффициент

.Заметим, что коэффициент  в данном случае не определяется непосредственно. Однако из МНК известно, что

в данном случае не определяется непосредственно. Однако из МНК известно, что

В случае  , можно получить следующее уравнение регрессии:

, можно получить следующее уравнение регрессии:

Или

Однако, метод первых разностей предполагает уж слишком сильное упрощение ( ). Поэтому более предпочтительными являются приведенные выше итерационные методы.

). Поэтому более предпочтительными являются приведенные выше итерационные методы.

Вывод

В силу ряда причин в регрессионных моделях может иметь место корреляционная зависимость между соседними случайными отклонениями. Это нарушает одну из фундаментальных предпосылок МНК. Вследствие этого оценки, полученные на основе МНК, перестают быть эффективными. Это делает ненадежными выводы по значимости коэффициентов регрессии и по качеству самого уравнения. Поэтому достаточно важным является умение определить наличие автокорреляции и устранить это нежелательное явление. Существует несколько методов определения автокорреляции, среди которых были выделены графический, метод рядов, критерий Дарбина-Уотсона.

При установлении автокорреляции необходимо в первую очередь проанализировать правильность спецификации модели. Если после ряда возможных усовершенствований регрессии автокорреляция по-прежнему имеет место, то, возможно, это связано с внутренними свойствами ряда отклонений. В этом случае возможны некоторые преобразования, устраняющие автокорреляцию. Среди них выделяется авторегрессионная схема первого порядка AR(1). Для применения указанных схем необходимо оценить коэффициент корреляции между отклонениями. Это может быть сделано различными методами: на основе статистики Дарбина-Уотсона, Кохрана-Оркатта, Хилдрета-Лу и др. В случае наличия среди объясняющих переменных лаговой зависимой переменной наличие автокорреляции устанавливается с помощью h-статистики Дарбина. А для ее устранения в этом случае предпочтителен метод Хилдрета-Лу.

Список использованной литературы

1. Анатольев С. Эконометрика для продолжающих (Эконометрика-3). Курс лекций, М.: Российская Экономическая Школа, 2002-2003

2. Давнис В.В., Тинякова В.И., Мокшина С.И., Воищева О.С., Щекунских С.С. Эконометрика сложных экономических процессов, Воронеж: ВГУ, 2004.

3. Доугерти Кр. Введение в эконометрику, М.: ИНФРА-М, 1997.

4. Елисеева И. И. Эконометрика, М.: Финансы и статистика, 2001.

5. Кремер Н. Ш., Путко Б. А. Эконометрика, М.: ЮНИТИ-ДАНА, 2002.

6. Магнус Я. Р. Эконометрика. Начальный курс, М.: Дело, 1997.

7. Носко В.П. Эконометрика: Введение в регрессионный анализ временных рядов, Москва, 2002.

Приложение А

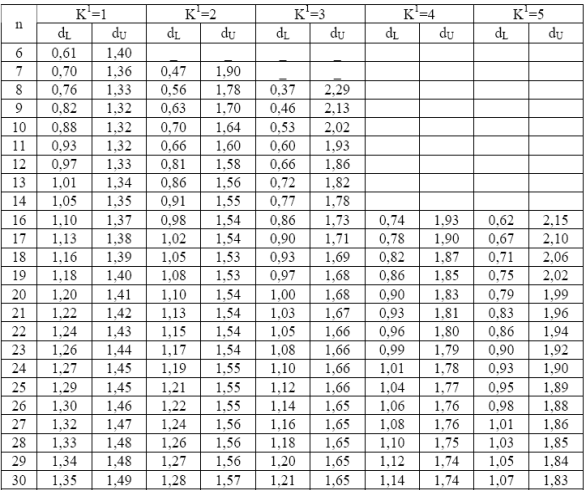

Значения статистик Дарбина – Уотсона dL dU при 5%- ном уровне значимости